최태원 SK그룹 회장이 인공지능(AI) 관련 많은 난제를 다양한 리더들과 손잡고 풀어야 한다며 글로벌 AI 리더들과 협력을 강조했다.

최 회장은 "AI에 대해 많은 사람들이 '안다'고 하지만 아직 초기 단계인 만큼 모르는 것이 더 많으며, 다양한 분야의 리더들이 함께 고민하며 풀어야 하는 많은 난제들이 존재한다”며 “AI는 우리 모두의 삶과 사회에 광범위한 변화를 가져올 기술이기 때문에 이 변화를 긍정적으로 이끌기 위해 우리 모두가 협력해야 한다"고 했다.

최 회장은 SK그룹이 4일 서울 코엑스에서 개최한 ‘SK AI 서밋(SUMMIT) 2024’에서 첫 기조연설자로 나서 이 같이 밝혔다. ‘함께하는 AI, 내일의 AI(AI together, AI tomorrow)’를 주제로 5일까지 열리는 이 행사는 SK그룹이 전 세계 AI 대표 기업인과 학자, 전문가 등을 현장 또는 화상으로 초청해 처음 마련한 국내 최대 규모의 AI 심포지움이다.

최 회장은 "AI가 계속 성장하기 위해 해결해야 할 몇 가지 보틀넥(병목현상)이 있다"고 진단했다. 대표적으로 AI에 대한 투자를 회수할 ‘대표 사용 사례’(Killer Use Case)와 수익 모델 부재, AI 가속기 및 반도체 공급 부족, 첨단 제조공정 설비 부족, AI 인프라 가동에 소요되는 에너지(전력) 공급 문제, 양질의 데이터 확보 문제 등 5가지 병목현상에 대한 해법도 제시했다.

최 회장은 "SK는 반도체부터 에너지, 데이터센터의 구축 운영과 서비스의 개발까지 가능한 전세계에서 흔치 않은 기업"이라고 강조하면서 "우리는 부족한 부분을 보완하기 위해 각 분야 세계 최고 파트너들과 협업하고 있다"고 했다.

이어 "SK와 파트너들의 다양한 설루션을 묶어 AI 보틀넥을 해결하고 좀 더 좋은 AI가 우리 생활에 빨리 올 수 있도록, 글로벌 AI 혁신을 가속화하는데 기여하겠다"는 비전을 제시했다.

최 회장은 "인터넷 시대의 진입에 있어 선도적인 역할을 했던 한국이 AI 시대에도 선도적인 역할을 수행하려면 AI 인프라에 대한 투자가 중요하다"면서 대규모 AI 데이터센터 구축과 양질의 데이터 확보, AI 시대에 맞는 인재 양성의 중요성을 강조했다. 아울러 SK의 AI 인프라를 통해 국내 스타트업들의 성장과 AI 생태계 구축을 지원하겠다고 했다.

이날 최 회장의 기조연설이 이어지는 중간 중간 SK와 긴밀한 협력관계를 맺고 있는 글로벌 빅테크 수장 등 AI 업계의 스타급 인사들이 영상으로 등장해 눈길을 끌었다.

사티아 나델라 마이크로소프트 CEO, 젠슨 황 엔비디아 CEO, 웨이저자 TSMC CEO 그리고 컴퓨터 구조 및 설계분야의 최고 전문가인 데이비드 패터슨 미국 UC버클리대 교수 등이 AI 시대 협력의 중요성에 대해 밝혔다.

최 회장은 사티아 나델라 MS CEO의 영상 메시지를 소개하며 "MS는 탄소중립에 대해 많은 관심을 갖고 계속해서 발전해 나갔는데 나도 영향을 받았다"며 "AI 데이터센터에 상당히 많은 전기 에너지가 들어가는 만큼 전력의 규모도 문제지만, 탄소발자국을 줄이면서 안정적인 전력 공급을 위해 함께 고민하고 있다"고 전했다.

최 회장은 SK가 다양한 기술과 역량을 활용해 이 문제를 해결하기 위해 노력하고 있다고 최 회장은 강조했다. 그러면서 △SK가 투자한 테라파워의 SMR(소형모듈원전) 사업 △SK에코플랜트의 분산형 전원 공급 솔루션 사업 △SK엔무브의 데이터센터 액침 냉각 사업 △SKC와 앱솔리스의 유리 기판 사업 등을 소개했다.

최 회장은 최근 젠슨 황 CEO와 만났던 에피소드를 소개하며 "젠슨 황 CEO는 뼛속까지 엔지니어인데 마치 한국인 같다"면서 "빨리빨리 일정을 앞당기길 원한다"고 말했다. 그러면서 "엔비디아는 새로운 그래픽처리장치(GPU)가 나올 때마다 SK하이닉스에 더 많은 HBM을 요구하고, 합의된 일정도 항상 앞당겨 달라고 요청한다"며 "지난번 젠슨 황과 만났을 때 HBM4 공급을 6개월 당겨달라고 했다"고 소개했다.

이에 SK하이닉스는 내년 하반기 양산을 목표하고 있는 6세대 고대역폭메모리(HBM4)와 관련해 엔비디아의 요청에 본래 스케줄보다 양산 시기를 6개월 가량 앞당기기 위해 노력 중이라고 전했다. 최 회장은 "엔비디아가 매년 새로운 버전의 더 좋은 칩을 내놓으면서 더 많은 HBM을 요구하고 있다"며 "즐거운 비명이라고 할 수도 있겠지만 SK하이닉스는 그것 때문에 더 바빠진다"고 말했다.

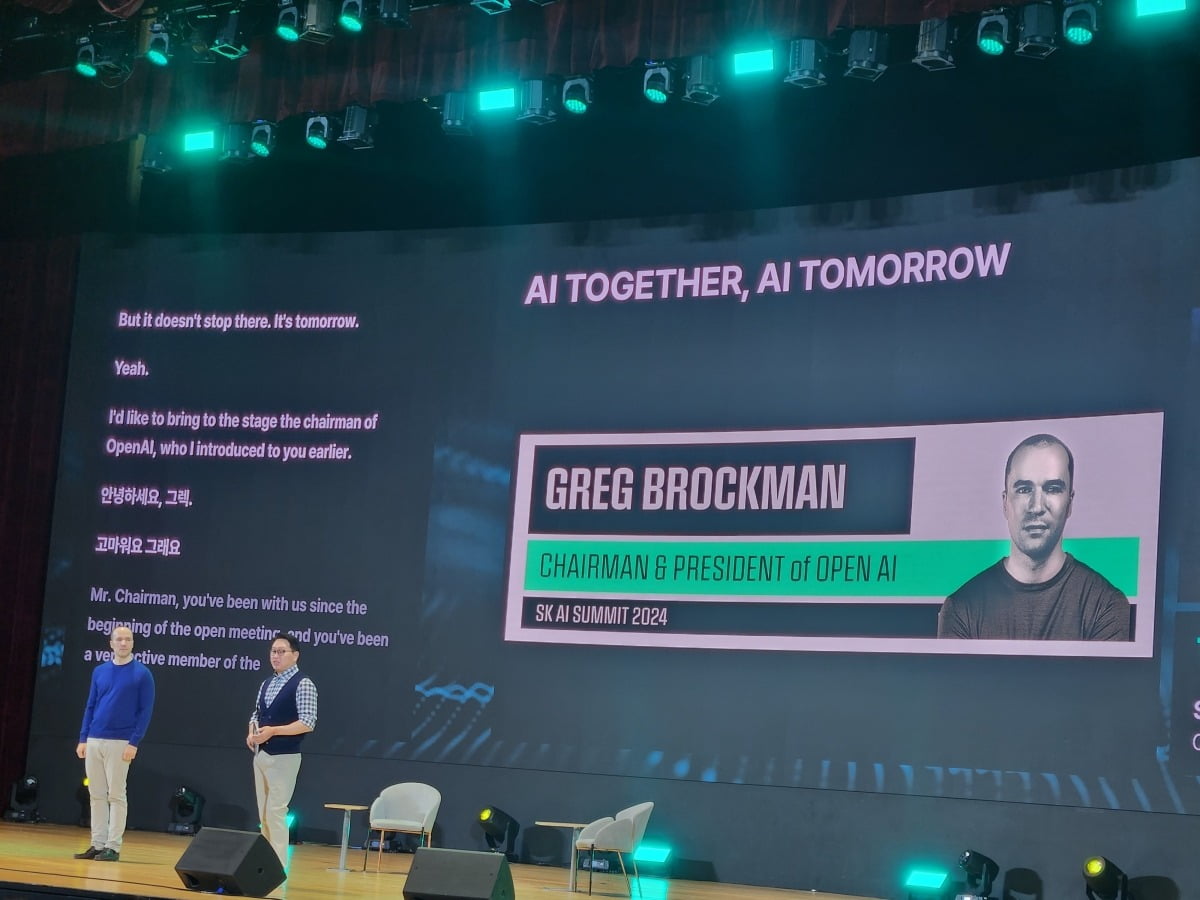

그렉 브로크만 오픈AI 회장 겸 사장은 직접 무대에 올라 'AI의 미래'를 주제로 현장 대담에 참석했다.

SK그룹의 AI 사업을 이끄는 CEO들도 무대에 올랐다. 유영상 SK텔레콤 사장은 이날 기조연설을 통해 "인공지능 데이터센터(AI DC), 그래픽 처리장치 클라우드 서비스(GPUaaS), 에지 AI 등 세 가지 축을 중심으로 'AI 인프라 슈퍼 하이웨이'를 구축해 대한민국이 AI G3로 도약할 수 있도록 앞장설 계획"이라고 밝혔다.

유 사장은 AI 데이터센터와 관련해 국내 지역 거점에 100MW(메가와트) 이상 전력이 필요한 하이퍼스케일급을 시작으로, 향후 그 규모를 GW(기가와트)급 이상으로 확장해 아시아태평양 지역의 'AI DC 허브'로 도약한다는 구상도 밝혔다.

미국 람다와 협력해 다음 달 H100 기반의 GPUaaS를 시작으로, 내년 3월에는 국내 최초로 최신 GPU H200을 도입해 물량을 단계적으로 확대하는 동시에 내년부터 총 1000억원을 투자해 리벨리온의 신경망 처리장치(NPU), SK하이닉스의 HBM, SK텔레콤과 파트너사가 보유한 다양한 AI 데이터센터 솔루션을 결합한 '한국형 소버린 AI'를 구현할 계획도 밝혔다.

곽노정 SK하이닉스 사장은 내년 초 업계 최대 용량·최고층의 '48기가바이트(GB) HBM3E 16단' 제품 양산에 나선다고 밝혔다. HBM3E 16단은 8단 HBM 대비 학습 성능이 18%, 추론 성능이 32% 향상될 것으로 기대된다.

곽 사장은 "HBM4부터 16단 시장이 본격적으로 열릴 것으로 보인다"며 "이에 대비해 기술안정성 확보 차원에서 48GB HBM3E 16단 제품을 개발 중이며, 내년 초 고객에게 샘플을 제공할 예정"이라고 했다.

안옥희 기자 ahnoh05@hankyung.com